苹果周五出人意料地宣布,在推出其备受争议的儿童安全工具之前,它需要更多时间来改进这些工具。

寻求更多反馈

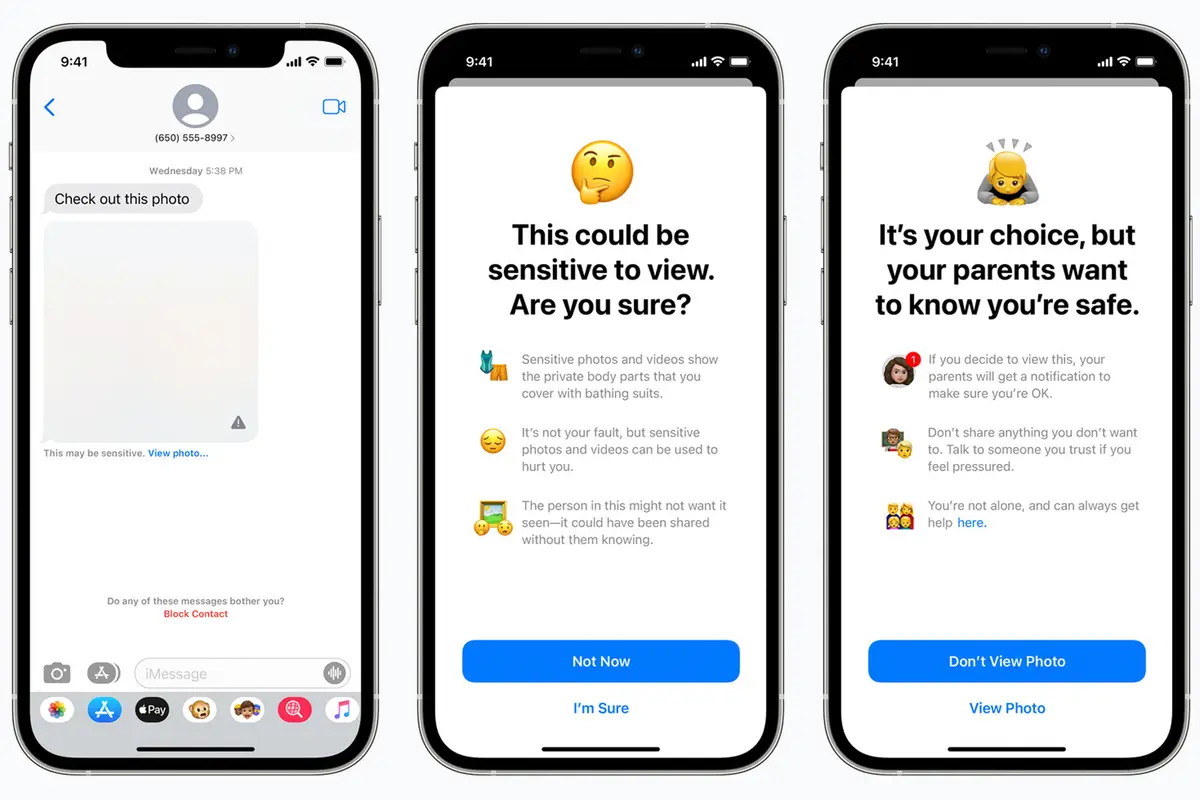

该公司表示,它计划获得更多反馈并改进该系统,该系统具有三个关键组成部分:针对 CSAM 材料的 iCloud 照片扫描、用于保护儿童的设备上消息扫描以及旨在保护儿童的搜索建议。

自从 Apple 宣布推出这些工具以来,它就面临着来自世界各地的相关个人和权利团体的猛烈批评。 该公司似乎难以解决的一个大论点似乎是专制政府有可能迫使 Apple 监控的不仅仅是 CSAM。

[通过 Computerworld 的时事通讯了解最新的 IT 思想领导力、见解、操作方法和分析。 ]

谁看守望者?

爱德华斯诺登被指控泄露美国情报,现在是一名隐私倡导者,他在推特上警告说:“别搞错了:如果他们今天能扫描儿童色情片,明天他们就能扫描任何东西。”

批评者说,这些工具可能被利用或扩展以支持思想审查或以其他方式威胁自由思想。 Apple 的回应——它不会扩展系统——被认为有点天真。

“我们曾面临构建和部署政府强制更改的要求,这些更改以前会降低用户的隐私,并且坚决拒绝了这些要求。 我们以后会继续拒绝他们。 让我们明确一点,这项技术仅限于检测存储在 iCloud 中的 CSAM,我们不会同意任何政府扩展它的要求,”该公司表示。

“要扩大苹果正在构建的狭窄后门,只需扩展机器学习参数以寻找其他类型的内容,”电子前沿基金会反驳道。

苹果听取用户的意见(以一种好的方式)

在一份广泛发布给媒体的声明中(在美国假期前的星期五,有时会发布坏消息)关于暂停,Apple 说:

“根据客户、倡导团体、研究人员和其他人的反馈,我们决定在未来几个月内花更多时间收集意见并做出改进,然后再发布这些至关重要的儿童安全功能。”

这是该公司必须采取的举措。 8 月中旬,90 多个非政府组织在一封公开信中联系该公司,请求其重新考虑。 那封信是由 Liberty, Big Brother Watch 签署的。 ACLU、民主与技术中心、自由表达中心、EFF、ISOC、隐私国际等。

细节中的魔鬼

这些组织警告说,该公司的提议存在一些弱点。 一个非常切入点:系统本身可能会被滥用的成年人滥用。

他们写道:“父母冷漠的家庭账户中的 LGBTQ+ 青少年尤其处于危险之中。” “由于这一变化,iMessages 将不再为这些用户提供机密和隐私。”

人们仍然担心苹果提议的系统可能会被扩展。 CDT 安全与监视项目联合主任莎伦·布拉德福德·富兰克林警告说,各国政府“将要求 Apple 扫描并屏蔽侵犯人权、政治抗议和其他应作为自由表达受到保护的内容的图像,这构成了 自由民主社会的支柱。”

苹果的捍卫者表示,苹果一直试图实现的目标是维护用户数据的整体隐私,同时创建一个只能收集非法内容的系统。 他们还指出了该公司在其系统中内置的各种故障保护措施。

这些论点没有用,Apple 的高管们肯定会注意到我看到的同样的社交媒体反馈,这代表了对提案的极度不信任。

接下来发生什么?

苹果的声明没有说。 但鉴于该公司自宣布与来自所有市场的媒体和相关团体就此事举行会议以来已经花费了数周时间,因此其儿童保护工具的第二次迭代可能会解决一些问题似乎是合乎逻辑的。